De la visibilidad al razonamiento: las nuevas reglas de la búsqueda en la era de la IA

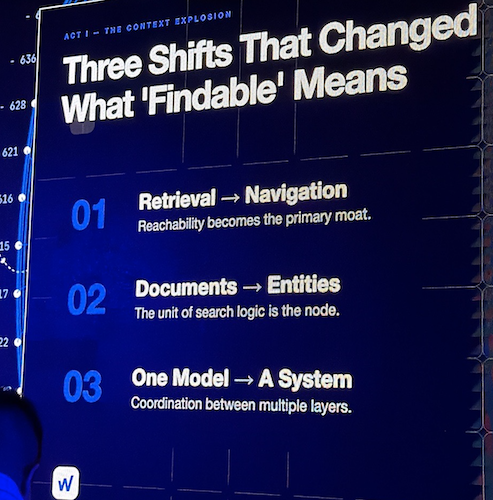

10 charlas, un mismo mensaje repetido: el SEO no muere, pero se transforma en otra cosa. La pelea por aparecer en una lista de 10 enlaces se diluye, ahora también competimos por ser elegidos como evidencia dentro de pipelines de IA que recuperan, verifican y sintetizan información en milisegundos.

Esto es lo que me llevo del Día 1, el dedicado a «la ciencia», primero las top 5 ideas y después charla a charla.

TL;DR — Las 5 ideas que unen el primer día de #SEOWeek 2026

- El ranking ya no es la batalla; la elegibilidad sí lo es. Antes de que se decida qué posiciona, los sistemas de IA filtran qué entra en el conjunto de candidatos. Si tu contenido no es matemáticamente cercano a la consulta, ni se rastrea, ni se puntúa, ni compite. Todo lo que veníamos optimizando ocurre después de esa primera capa.

- La unidad de competencia es el pasaje o porción de texto, no la página. La IA descompone tu contenido en fragmentos, los convierte en vectores y evalúa cada afirmación por separado. Una página entera puede ser sólida y aun así perder porque sus pasajes individuales no aportan ganancia de información. Cada frase tiene que ganarse su sitio.

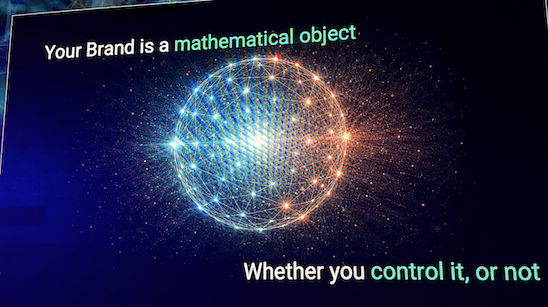

- Tu marca es un objeto matemático: el centroide. El conjunto de tus contenidos forma un punto medio en un espacio vectorial. Ese centroide es la identidad real de tu marca para la IA, no la home ni el manual de marca. Si tus piezas o activos envían señales contradictorias, el centroide se dispersa, te confundes con la competencia y dejas de ser recuperable.

- La nueva métrica es la confianza, no el volumen. Los re-rankers premian la certeza y penalizan la ambigüedad (lenguaje vago, hedging, datos sin respaldo). Más contenido no es la solución pero mejor estructura sí. Datos frescos, entidades claras, grafos de conocimiento, identificadores únicos consistentes y citaciones verificables son lo que mueven la aguja.

- El SEO de 2026 es ingeniería y negocio, no tácticas. Las herramientas comerciales se han quedado atrás haciendo cuentas léxicas con un wrapper de IA por encima. La ventaja la tienen los profesionales que construyen sus propias herramientas, dominan el contexto de los modelos y saben traducir todo esto a dinero. La atribución clásica está rota y ya hay que aprender a vender impacto con fuzzy math.

Las 10 charlas del primer día de #SEOWeek 2026, una a una

A continuación un resumen breve de cada ponencia en el orden en que se impartieron.

1. Krishna Madhavan (Microsoft)

Ponente: Krishna Madhavan, Microsoft

Charla: The Invisible, Converged Web: Architecting Visibility for the AI Economy

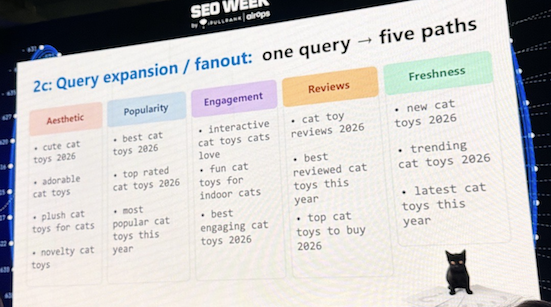

Krishna abrió la jornada con el mapa más completo del día explicando cómo viaja realmente una consulta dentro de un sistema de IA. Toda búsqueda atraviesa un ADN común —comprensión, transformación, expansión (query fanout), recuperación multirruta, deduplicación, ranking y filtrado de elegibilidad— y solo después se bifurca. La rama clásica genera snippets en tres pasos; la rama de grounding entra en una fase mucho más exigente de selección de evidencia y verificación cruzada entre modelos, donde una IA literalmente critica las afirmaciones de otra antes de citarlas.

Su mensaje práctico: si los motores no pueden leer tu contenido, no hay visibilidad. Encabezados semánticos, JavaScript prudente, IndexNow para notificar cambios reales (ya impulsa más del 50% de las nuevas URLs en Bing y Copilot) y el uso fino de data-nosnippet para controlar qué partes cedes a la IA sin perder ranking. Y un avance exclusivo, ya que Microsoft prepara funciones que mostrarán la intención exacta de las consultas grounded, mapeo de temas y métrica de cuota de citaciones en Bing Webmaster Tools.

Sigue al autor:

https://x.com/kmadhavan77

https://www.linkedin.com/in/kmadhavan7

2. Andrea Volpini (WordLift)

Ponente: Andrea Volpini, WordLift

Charla: Beyond the Million-Token Window: TurboQuant and RLM-on-KG

Andrea atacó una creencia muy extendida sobre los modelos con ventanas de contexto gigantes resuelven el problema de la memoria. Aunque ya hablamos de capacidades casi infinitas, el fenómeno “lost in the middle” persiste, los modelos siguen ignorando lo que está en el centro de prompts largos, y el coste computacional crece de forma cuadrática. Más contexto no es la solución, mejor navegación si lo es.

Su propuesta: convertir la información no estructurada en grafos de conocimiento basados en entidades, con tripletas RDF e identificadores únicos consistentes. En su investigación reciente, los datos estructurados aislados apenas mueven la aguja en Vertex AI, pero al usarlos para generar páginas de entidad lógicamente conectadas, la precisión de recuperación sube un 20%. Combinado con Modelos de Lenguaje Recursivos sobre grafos, su equipo midió hasta un 71% de mejora frente a GraphRAG en preguntas que exigen razonar sobre evidencia dispersa. La frase para enmarcar: «no es un juego de volumen, es un juego de conexión».

Sigue al autor:

https://x.com/cyberandy

https://it.linkedin.com/in/volpini/it

3. Mike King

Ponente: Mike King, iPullRank

Charla: F*ck It, I’ll Do It Myself

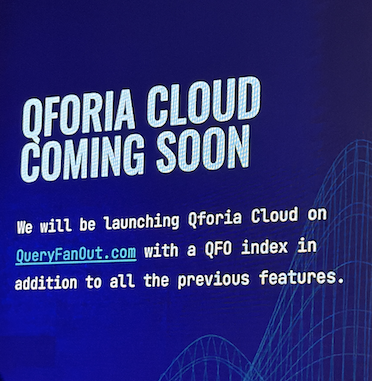

Ponencia combativa de Mike que denunció que la mayoría del software SEO comercial sigue haciendo cuentas léxicas (TF-IDF, BM25) con un wrapper de ChatGPT por encima, mientras Google opera con búsqueda semántica desde 2013.

La industria ha ignorado las filtraciones de Google y los hallazgos del juicio antimonopolio del DOJ (más de 14.000 puntos de datos) y sigue vendiendo aproximaciones a PageRank cuando los vector embeddings son hoy infinitamente más importantes.

Faltan métricas confirmadas, índices públicos de embeddings, modelos híbridos y herramientas que monitoricen el código HTTP 499 (cuando un agente de IA cancela la petición porque tu servidor tarda demasiado).

Su respuesta no fue queja, fue un kit completo de herramientas open source:

- Search Telemetry Project (rastreador con 3.000 métricas depuradas de las filtraciones)

- Vactor (red distribuida de embeddings)

- Vector Workstation (mapas temáticos 3D)

- Q4ia Cloud

- Agent Skills Manager

Stack recomendado: N8N, Ollama, Gemma para embeddings, language-track para chunking.

Su pregunta final: ¿estás jugando para ganar, o jugando por jugar?

Me resulta familiar porque……mira la home de mi web :)

Sigue al autor:

https://x.com/iPullRank

https://www.linkedin.com/in/michaelkingphilly

4. Noah Learner (Sterling Sky)

Ponente: Noah Learner, Sterling Sky

Charla: Build the Tool Your Team Actually Needs

Noah llevó la idea de Mike al plano práctico mostrando SEO Loop, una plataforma que construyó él solo con Claude Code para resolver un dolor real que sufren las agencias (la rotación de clientes).

En lugar de informes con impresiones y rankings, traduce el volumen de búsqueda directamente en una fórmula de ingresos como volumen × CTR × AOV × tasa de conversión × tasa de lead y lo conecta con paneles ejecutivos, descubrimiento de oportunidades automático y mapas temáticos por cuadrantes.

Consejo técnico (que se repitió en otras ponencias): domina el contexto del LLM. Trabaja siempre dentro del primer 20% de la ventana de contexto, condensa al cambiar de sesión, reduce tu CLAUDE.md al mínimo imprescindible.

Sus reglas estrictas (límite de 500 líneas por commit, prohibición de deploys los fines de semana, tests de “forma” obligatorios) hicieron caer su tasa de errores del 80% al 15%.

La reflexión de fondo es que ser SEO experto en tu dominio + IA puede igualar la producción de equipos de 5 a 20 personas.

Sigue al autor:

https://x.com/noahlearner

https://www.linkedin.com/in/noahlearner

5. Annie Cushing

Ponente: Annie Cushing

Charla: From Vibes to Veteran: 7 Tips to Disaster-Proof Your Code

Annie complementó la parte de seguridad con un repaso a desastres reales del último año:

- bases de datos de producción borradas por agentes

- contraseñas “123456” en herramientas de IA con datos de 64 millones de candidatos

- código fuente expuesto

- bandejas de correo eliminadas

Su mensaje no fue alarmista, sino de añadir disciplina y tratar a la IA como a un nuevo empleado al que tienes que enseñar reglas explícitas.

Su manual práctico cubre cinco frentes:

- estructura y cumplimiento (nunca credenciales en código, archivos .env, archivo de reglas en .md)

- diseño modular (de un archivo de 6.000 líneas a 32 directorios bien estructurados, variables CSS para la marca)

- control de la IA (uno o dos intentos máximo y luego logging estratégico

- nunca dejar que adivine en bucle), dominio de Chrome DevTools (Capture Node Screenshot, pestaña Computed, copiar outerHTML como referencia)

- prevención de fallos (stability freezes, backups redundantes, CI/CD obligatorio).

Su técnica avanzada: fan-out / fan-in, usando un modelo potente como orquestador y agentes baratos en paralelo para tareas masivas.

Sigue a la autora:

https://x.com/AnnieCushing

https://www.linkedin.com/in/anniecushing

6. Dale Bertrand (Fire and Spark)

Ponente: Dale Bertrand, Fire and Spark

Charla: Prioritize Investments by Financial Impact

Dale empezó con la mejor analogía del día (y más tierna) que fue el puesto de limonada de su hijo, que hizo un test A/B (su hermana de dos años vs. el perro Ginger) sin importarle el rigor estadístico, porque solo quería una dinero para una Nintendo Switch.

Esa es la conversación con la dirección, las métricas tradicionales del SEO son precisas pero inútiles, hasta el 70% del tráfico originado por IA aterriza en GA4 como “directo”, sin atribución posible.

Su solución es el marco de las 3 T:

- métricas Tight (alineadas con lo que importa a la dirección: ingresos, payback, CAC)

- métricas True (direccionalmente correctas aunque no perfectas)

- métricas Translated (en lenguaje de negocio).

Y el fuzzy math como herramienta principal.

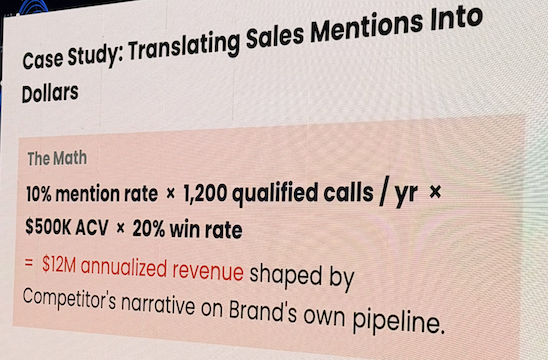

Caso real: una página comparativa de un competidor recibía solo 40 clics al mes según las herramientas, pero aparecía en el 64% de las respuestas de IA y el 10% de los leads la mencionaban en llamadas.

Multiplicando por 1.200 leads anuales, 500.000 USD de contrato y 20% de cierre, el riesgo era de 12 millones. El CFO aprobó el presupuesto en la siguiente reunión.

Sigue al autor:

https://x.com/dbertrand

https://www.linkedin.com/in/dalebertrand

7. Jori Ford

Ponente: Jori Ford

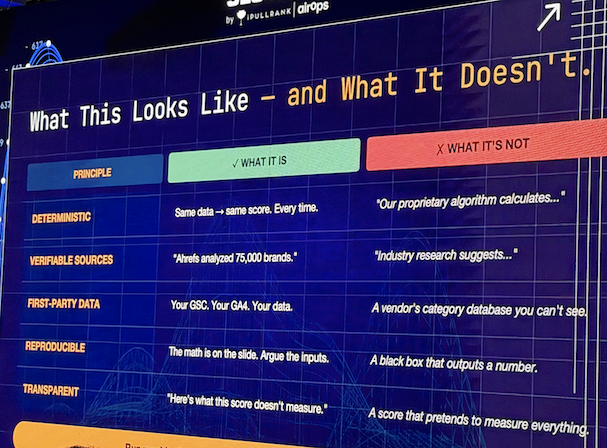

Charla: HEO: The Hybrid Engine Score

Jori propuso la herramienta interna que sostiene toda la conversación con la dirección, llamada HEO Score (Hybrid Engine Optimization), un sistema de puntuación semanal y reproducible que mide cinco señales:

- Presencia

- Prominencia

- Calidad de Citación

- Validación

- Impacto de Negocio

Sobre un grupo cerrado de 40 seed queries (no inventadas) extraídas de fuentes reales como Google Search Console, ventas, soporte y reseñas, el objetivo es dejar de saltar entre 20 herramientas con métricas subjetivas y consolidar un único marco de gobernanza.

El modelo permite elegir un perfil estratégico (Notoriedad, Conversión o Autoridad) que pondera las señales, e incorpora un protocolo de diagnóstico que solo activa la investigación cuando hay un “colapso de señal” real, definido como una caída de 3 puntos.

Su caso con Aspen Group reveló hallazgos imposibles de detectar con métricas aisladas, ya que las consultas locales pesaban cuatro veces más en LLMs que en Google y la nota umbral para recomendaciones especializadas (ej. dentista) era ya superior al clásico 4,6.

La disciplina, dice Jori, reduce el análisis a unas 2 horas semanales y genera la confianza ejecutiva que sobrevive a cualquier cambio de algoritmo.

Sigue a la autora:

https://x.com/chicagoseopro

https://www.linkedin.com/in/chicagoseopro

8. Metehan Yeşilyurt

Ponente: Metehan Yeşilyurt

Charla: Everything Is an Entropy Game: What Dies Between Retrieval and Citation

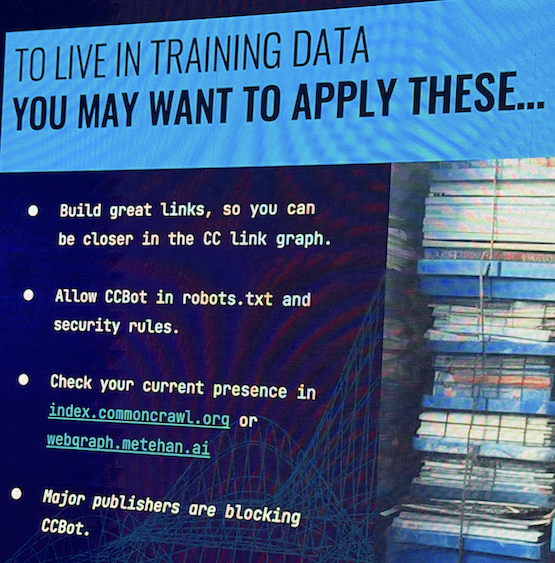

Metehan dedicó un año a reverse-engineering de configuraciones reales de ChatGPT, Perplexity y Gemini y volvió con una tesis poderosa de que todo es un juego de entropía.

Los re-rankers actuales son, en esencia, máquinas de confianza que puntúan cuánto reduce un pasaje la incertidumbre de la respuesta. El lenguaje vago, las hedging phrases, el contenido condicional y los idiomas con tokenización ineficiente (alfabetos no ingleses, emojis) aumentan entropía y son penalizados.

Lo confiable, fresco y estructurado gana, esto explica por qué páginas mediocres pero consistentes superan a páginas brillantes pero ambiguas.

Aportó además un dato incómodo para muchos editores ya que en sus experimentos con SEO programático masivo, el tráfico de bots de IA (GPTBot, ChatGPT-User) ya supera al tráfico orgánico tradicional de Google en bastantes ecosistemas.

Bloquear CCBot de Common Crawl para “proteger” el contenido es un error estratégico y te expulsa del centro de gravedad algorítmico desde el que se construyen las próximas generaciones de modelos.

A considerar: auditar logs en busca de errores 4xx hacia bots de IA, porque a veces arreglar un solo problema de rastreo dispara la visibilidad.

Sigue al autor:

https://x.com/metehan777

https://tr.linkedin.com/in/metehanyesilyurt

9. Scott Stouffer

Ponente: Scott Stouffer

Charla: Is AI Seeing the Brand You Think You’ve Built?

Scott aportó la idea más conceptual y, para muchos, la más reveladora del día: tu marca existe como un objeto matemático dentro de los sistemas de IA.

Cada fragmento de tu contenido se convierte en un vector, los vectores se agrupan en clústeres de significado y el punto medio de todos ellos es el centroide.

Ese centroide es la identidad real de tu marca para la IA, independientemente de lo que digan tu home, tu manual de marca o tus guías de tono.

El problema es la convergencia, ya que, como casi todas las marcas siguen las mismas mejores prácticas, usan las mismas fuentes y estructuras, sus centroides colapsan en la misma región del espacio, entonces para la IA, son sustituibles.

Y ser sustituible es el mayor riesgo porque el sistema solo recupera a un par de representantes y descarta al resto. La solución no es publicar más, sino publicar diferente, encontrar el ángulo que aleje tu centroide de la zona de colisión.

Y abandonar la optimización estática para adoptar un ciclo continuo de medir, ajustar y volver a medir, porque cada nueva pieza tira ligeramente del centroide y, sin control, deriva hasta fragmentar la identidad de la marca.

Sigue al autor:

https://x.com/scott_stouffer

https://www.linkedin.com/in/scottstouffer

10. Jeff Coyle (Siteimprove)

Ponente: Jeff Coyle, Siteimprove / ex-MarketMuse

Charla: From Showing Up to Winning

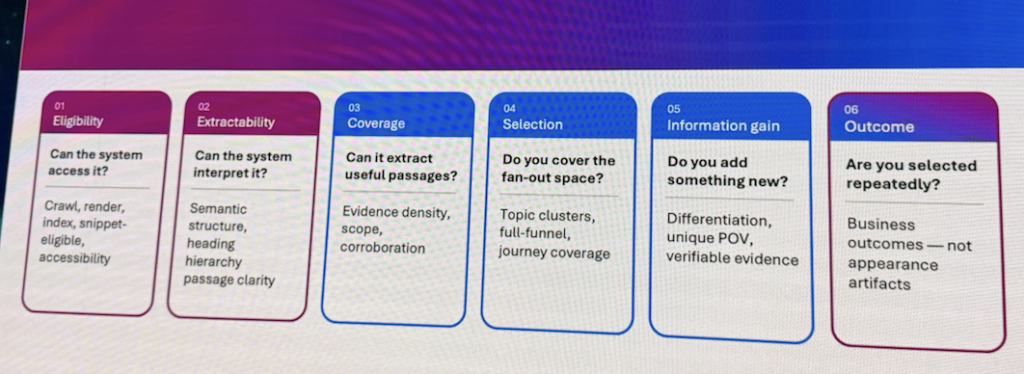

Jeff cerró el día tirando del hilo entre todas las ideas anteriores. Según él medir apariciones y citas es insuficiente, hay que entender el mecanismo.

La elegibilidad técnica (rastreabilidad, renderizado, encabezados semánticos, accesibilidad) es la primera barrera y la mayoría de los fracasos en búsqueda IA empiezan ahí.

Lo ilustró con un caso real de una gran organización sanitaria que publicó artículos de “mitos sobre enfermedades” con encabezados mal estructurados y la IA acabó atribuyéndoles que respaldaban los mitos como causa real. Una crisis de relaciones públicas valorada en miles de millones, contenida en pocos días gracias a la monitorización.

Una vez superada la elegibilidad, Jeff explicó que Google ya no hace una búsqueda lineal sino que ejecuta query fanout (hasta 15 consultas paralelas con 20 resultados cada una), formando un pool de 600 candidatos para cubrir todo el viaje del usuario.

Ahí es donde compite el pasaje o porción de texto, no la página, cada afirmación se evalúa por separado y, si no aporta ganancia de información ni puede corroborarse, se descarta y arrastra a sus vecinas.

El atajo de añadir bloques de FAQ con schema al final de la página es una trampa, a veces hace falta construir 12 artículos robustos para mover la selección de un solo pasaje.

Su frase final: para 2026, cada pasaje/porción importa.

Sigue al autor:

https://x.com/jeffrey_coyle

https://www.linkedin.com/in/jeffcoyle

¿Cuánto ha llevado este post?

El evento ha tenido lugar de 9 de la mañana a 17:00 de la tarde.

He usado como backup Plaud Pro para tomar notas y poder obtener trascripciones, traducciones y resúmenes de las charlas.

Después armar el artículo, con una base de Claude Projects, elegir y recortar las capturas realizadas durante la jornada.

Sin contar la asistencia al evento presencial, el post ha llevado alrededor de 3 horas.

Soy MJ Cachón

Consultora SEO desde 2008, directora de la agencia SEO Laika. Volcada en unir el análisis de datos y el SEO estratégico, con business intelligence usando R, Screaming Frog, SISTRIX, Sitebulb y otras fuentes de datos. Mi filosofía: aprender y compartir.